Qwen1.5系列的新成员——Qwen1.5-110B模型,以其超过千亿的参数规模和卓越的性能,吸引了众多研究者和开发者的目光。这款新发布的模型在基准评估和聊天机器人领域均表现出色,彰显了大规模模型在AI领域的巨大潜力。

Qwen1.5-110B模型详细介绍:https://qwenlm.github.io/blog/qwen1.5-110b/

AIGC专区:

https://heehel.com/category/aigc

更多消息:

https://heehel.com/category/ai-news

Qwen1.5-110B模型延续了Qwen1.5系列一贯的Transformer解码器架构,并融入了分组查询注意力(GQA)机制。这种设计使得模型在处理复杂任务时能够更高效地提取和整合信息,从而提升了整体性能。在基础模型评测中,Qwen1.5-110B的性能与Meta-Llama3-70B相当,展现了其在通用任务上的强大能力。

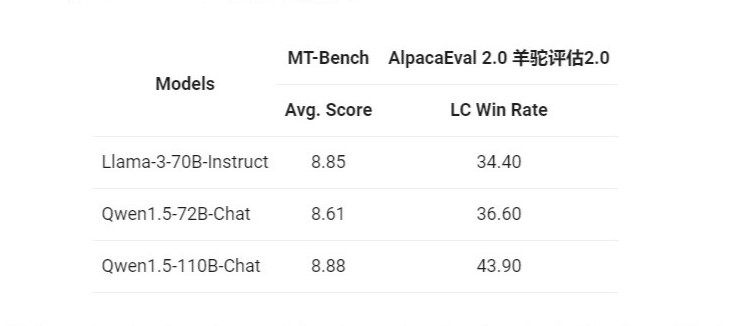

而在聊天评测方面,Qwen1.5-110B同样表现出色。在MT-Bench和羊驼评估2.0等权威测试中,该模型展现出了卓越的自然语言理解和生成能力,能够与用户进行流畅、自然的对话。这一特点使得Qwen1.5-110B在聊天机器人领域具有广泛的应用前景。

除了性能卓越外,Qwen1.5-110B还具备多语言支持的特性。该模型支持包括英语、中文、法语、西班牙语等在内的多种语言,使得它能够在全球范围内得到广泛应用。同时,该模型还支持长达32K的上下文长度,能够更好地处理复杂的对话场景。

值得一提的是,Qwen1.5-110B是Qwen1.5系列中最大的模型,也是该系列中第一个参数超过1000亿的模型。这一突破性的进展表明,通过不断增加模型参数和优化模型结构,研究人员可以进一步提升AI模型的性能。虽然Llama-3等模型已经展示了大规模数据的重要性,但Qwen1.5-110B的出现告诉研究人员,在数据扩展和模型大小之间找到平衡,是实现AI性能飞跃的关键。

喜好儿网

喜好儿网

用midjourney生成360°全景AI照片123-220x150.jpg)

Midjourney喂图-220x150.png)

体积像素艺术风格提示词——像素格子3D工艺品公仔-横-220x150.jpg)